V čem se liší text mining od data miningu?

Nejčastější odpověď na tuto otázku bývá: V data miningu získáváme užitečnou informaci ze strukturovaných (tabulkových, maticových) dat, zatímco v text miningu užitečnou informaci extrahujeme z textových dokumentů psaných v přirozeném jazyce. Pokud však sami začnete řešit některou z textminingových úloh, jakou je například klasifikace dokumentů do předem známých kategorií, zjistíte, že redukci dimenzionality je třeba věnovat mnohem větší úsilí než v klasickém data miningu. A právě tím se podle mého názoru text mining dosti odlišuje.

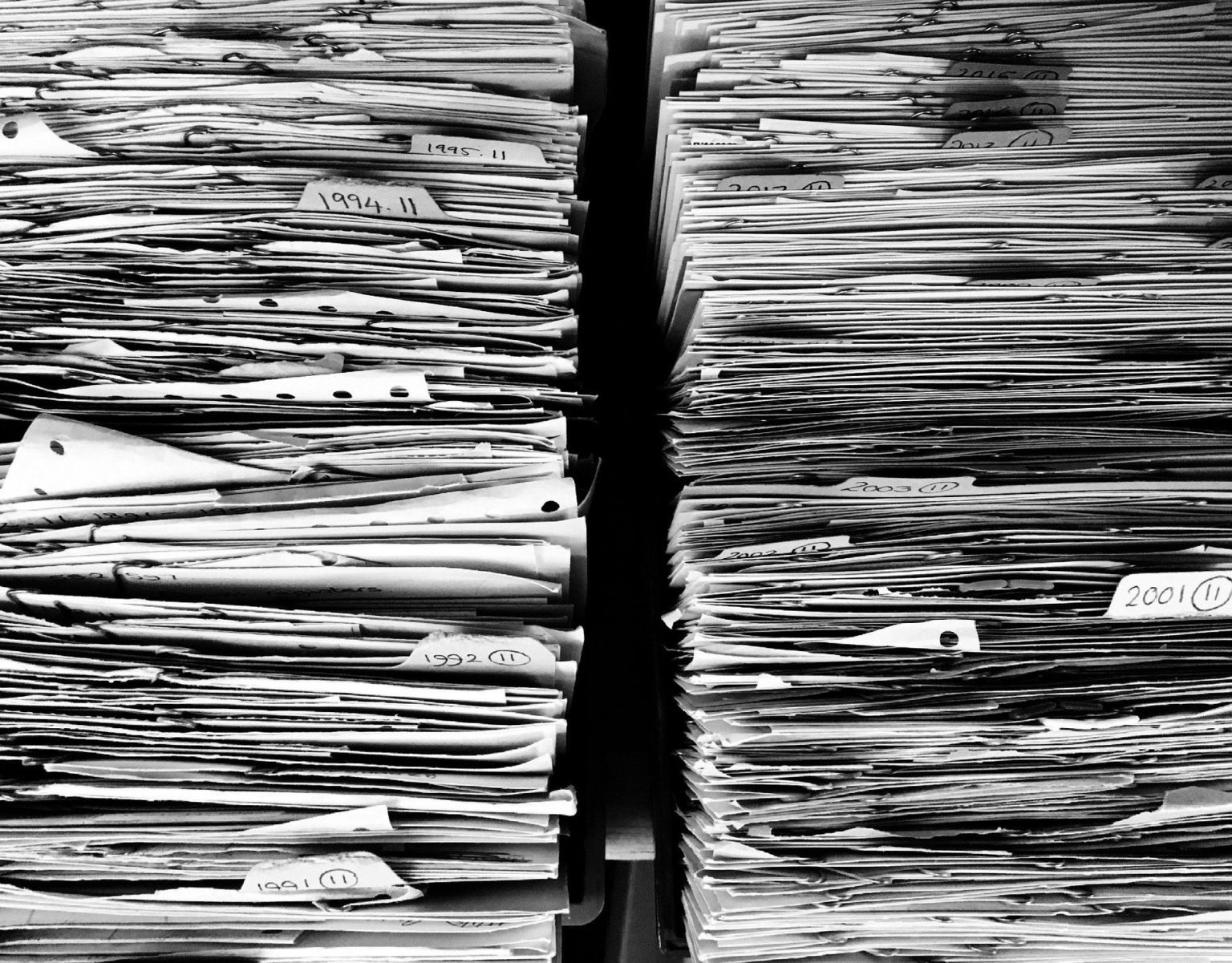

Z dokumentů se v text miningu nejprve extrahují klíčová slova, která slouží jako atributy (vlastnosti) dokumentů a utvoří sloupce ve strukturované matici dokumentů. Tím se textminingová úloha převede na dataminingovou. Ale díky ohromné variabilitě přirozeného jazyka získáme ze zpracovávaných dokumentů tolik klíčových slov, že i malá data se stanou velkými. Stačí se jen zamyslet nad tím, kolik má český jazyk slov, kolik má slovních tvarů, či kolik víceslovných hesel z nich můžeme sestavit.

Aby bylo možné širokou a zároveň řídkou matici dokumentů analyzovat, extrahovat z ní informace a budovat nad ní predikční modely, je třeba některá klíčová slova zanedbat a zbývající vhodně sloučit. Tím matici i zahustíme. Zpravidla potřebujeme z několika desítek až stovek tisíc atributů udělat desítky nebo stovky, tj. snížit počet sloupců o dva až čtyři řády!

Taková drastická redukce se nedělá v jednom kroku, ale postupně a různými přístupy. Na začátku nám pomohou jazykově závislé metody převzaté z počítačové lingvistiky. Dále můžeme navázat dekompozicí matic z lineární algebry nebo využít osvědčené modely témat. A až na konec lze aplikovat standardní výběr atributů na základě jejich užitečnosti v predikčních modelech.

Redukce atributů není nijak standardizovaný postup. Vždy záleží na analytikovi, jaké metody zvolí a jak je nakombinuje. Ačkoli redukce dimenzionality vybízí k experimentování, zpravidla na něj není dost výpočetních ani časových kapacit. Proto doporučuji si předem sestavit několik málo scénářů, jak zredukujeme svá velká data, a tohoto plánu se držet. Hlavně se nenechte unést nekonečným laděním a nastavováním. Důležité je dělat redukci postupně, být korektní, mít dostatečný nadhled nad jednotlivými kroky a nezapomenout, proč to všechno děláme. Naším primárním cílem přece není sestavit nebo redukovat matici dokumentů, ale dokumenty třídit a vybírat.

Pokud vám bude někdo tvrdit, že je nezbytné použít NLP, LDA, LSA, NMF, doc2vec, SVM, hluboké učení apod., nabízí vám jen jednu z mnoha alternativ. Nenechte se zastrašit množstvím existujících postupů. Nějaké si pro redukci vyberte, seznamte se s nimi, a hlavně dotáhněte úlohu do konce. Je to daleko přínosnější než půlroční zkoumání všech možných variant. Jak říká pravidlo KISS (Keep It Simple but not Stupid), udělejte redukci jednoduše a korektně.

Pokud vás zajímá pohled na analýzu textu v širším kontextu, přihlaste se na náš kurz Text mining.

Rádi byste se o statistice a analýze dat dozvěděli více? Chcete se stát mistrem ve svém oboru nebo si jen potřebujete doplnit znalosti? V ACREA nabízíme širokou nabídku kurzů pro váš profesní růst. Máte-li jiný dotaz. Nebojte se využít naši nezávaznou konzultaci, při které vám rádi zodpovíme všechny vaše dotazy a najdeme vhodné řešení.